Il tono di voce, la scelta di una parola piuttosto che di un’altra, la lunghezza di una frase sono tutti indizi cruciali per stabilire cosa stia accadendo nella mente di ciascuno di noi.

Si chiamano “tic verbali” e servono ad individuare e diagnosticare disturbi mentali come schizofrenia, depressione e bipolarismo.

Diversi studi hanno evidenziato come i medici siano in grado di diagnosticare – con precisione al 79% – se una persona svilupperà una psicosi in base all’analisi dei discorsi tenuti durante i colloqui. In oltre 45 minuti di intervista, può succedere che almeno in un’occasione l’intervistato perda il filo del discorso e dica qualcosa che non ha senso per quel contesto. Se il medico non è attento, può perdere questi segnali e sbagliare la diagnosi.

Ad una Intelligenza Artificiale non può succedere.

Va menzionato, a questo proposito, uno studio del 2015 basato su un programma automatizzato di analisi semantica e sintattica delle trascrizioni dei colloqui medico-paziente, che ha previsto – con una precisione del 100% – lo sviluppo di psicosi (leggi schizofrenia) in giovani a rischio.

Jim Schwoebel, ingegnere e CEO di NeuroLex Diagnostics, ha deciso di utilizzare questo studio come base per uno strumento di screening della schizofrenia per i medici di assistenza primaria.

Il nuovo prodotto della NeuroLex registrerà le conversazioni tra medico e paziente su uno smartphone/device nascosto e, utilizzando gli stessi criteri dello studio del 2015, analizzerà la trascrizione del discorso del paziente in cerca di “tic verbali”.

L’Intelligenza Artificiale fornirà un valore numerico che potrà essere usato dallo psichiatra per completare la sua diagnosi.

La stessa IA potrà essere utilizzata anche per monitorare, nel corso del tempo, i progressi del paziente in cura presso gli ospedali psichiatrici.

Naturalmente ci sono dei dubbi in merito all’utilizzo dell’IA per l’analisi e la conseguente diagnosi di disturbi mentali e riguardano tutti l’accuratezza dello strumento.

Se si utilizza un campione vocale di un determinato gruppo demografico (età, sesso, etnia, razza, regione geografica…), allora campioni normali di un altro gruppo potrebbero causare falsi positivi.

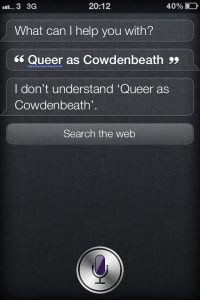

Un esempio è dato da SIRI e dal suo utilizzo in Scozia: un utente chiede “where is Cowdenbeath?”

Un tono di voce più basso o semplicemente una cadenza più morbida potrebbero portare l’IA a diagnosticare una depressione che in realtà non c’è.

There are many unmet mental health needs, and in the near-term the majority of mental health diagnosis and treatment will continue to be provided by humans. Technological approaches, such as machine learning, but also including telemedicine, smartphone apps, and wearable devices, have the potential to expand access and augment the work of clinicians. At the moment the quoted research is still quite preliminary, and I would not expect your family physician or psychiatrist to be using it just yet. However, this research does give us hope, and illustrates the promise of data science, and more specifically machine learning, in mental health.

(Arshya Vahabzadeh MD, Vice President of Health Strategy & Communications at Brain Power)